На Кантовском конгрессе отметили гонку между странами в развитии нейросетей

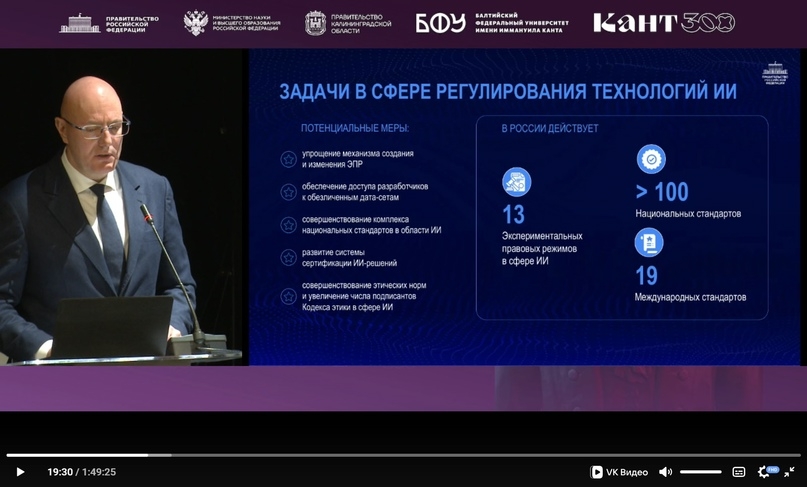

Устранение нормативно-правовых ограничений для разработок в сфере искусственного интеллекта и формирование доверия к ним путем этического регулирования необходимо для реализации Национальной стратегии по развитию искусственного интеллекта, заявил заместитель председателя правительства России Дмитрий Чернышенко 22 апреля на пленарном заседании Кантовского конгресса в Калининграде. Видеозапись заседания опубликована на странице БФУ имени Иммануила Канта в соцсети «ВКонтакте».

Чернышенко, курирующий в России вопросы науки, образования и цифровой трансформации, заявил, что современный мир уже невозможно представить без применения искусственного интеллекта. Он отметил огромную скорость в развитии ИИ, а также серьезное влияние, оказываемое искусственным интеллектом на общество.

«Мы видим, что в мире идет настоящая гонка, такая очень серьезная технологическая конкуренция между государствами, и более 60 стран включая, конечно Россию, разработали или разрабатываются и собственные национальные стратегии развития искусственного интеллекта, поскольку он качественно меняет бизнес-модели в экономике, оптимизирует, ускоряет процессы, формирует новые формы занятости», — заявил Чернышенко.

По экспертным оценкам, которые привел вице-премьер, общей вклад в технологии ИИ в глобальную экономику к 2030 году составит более $15 трлн (1400 трлн руб.). По мнению международного валютного фонда, среди развитых экономик доля рабочих мест, которые будут подвержены воздействию искусственного интеллекта, составит 60%, среди развивающихся экономик — 40%. Чернышенко признал обеспокоенность граждан рисками, возникающими при применении ИИ.

«По данным экспертов, около 73% людей по всему миру испытывают, мягко говоря, озабоченность из-за потенциальных рисков связанных с искусственным интеллектом. Но прежде всего, что беспокоит людей, конечно, то, что искусственный интеллект замещает человеческий труд. И возникает вопрос адаптации и трудоустройства освобождаемых специальностей. Но нарастает страх из-за угрозы безопасности, в том числе за счет стремительного роста вот этого качественного контента, который можно недобропорядочно использовать», — сообщил Чернышенко.

Вице-премьер указал на применение искусственного интеллекта для создания цифрового контента, который кажется аутентичным, но на самом деле является фальшивым. В качестве примера он привел превращение искусственным интеллектом образа героя русской сказки Иванушки в образ хоббита Фродо — героя из произведений британского писателя Джона Толкина.

Чернышенко отметил также «разрушительное действие технологий искусственного интеллекта» в военной сфере и указал на обсуждение возможности уничтожения человечества вышедшим из-под контроля искусственным интеллектом. По мнению чиновника, следует добиваться доверия к новым разработкам путем этического регулирования.

«Технологические революции уже в принципе человечеству давали опыт решения таких дилемм, прежде всего через развитие нормативного общественного регулирования, и один из вариантов — этическое регулирование. Оно направлено на рост доверия к новым разработкам, когда исчезает риск, например в нашем случае, случае России с избыточными запретами, которые замедляют темпы технологического развития», — заяви премьер-министр.

Чернышенко напомнил, что в России в 1921 году был принят добровольный кодекс этики в сфере искусственного интеллекта, к которому присоединились более 360 компаний и госструктур, включая 26 зарубежных организаций. С 2022 года действует специальная комиссия из экспертов от бизнеса и науки для эффективного исполнения положения данного кодекса. Чернышенко подчеркнул важность традиционных ценностей, которые формируют мировоззрение граждан. При этом, по его словам, зафиксированные в Национальной стратегии развития искусственного интеллекта цели предполагается достигать «в том числе за счет комфортной регуляторной юрисдикции».

«А для этого [комфортной юрисдикции] мы продолжим устранять нормативно-правовые ограничения для разработок, внедрения и использования искусственного интеллекта. У нас доказал свою эффективность подход, когда мы применяем для регулирования экспериментальные правовые режимы. Мы уже успешно таких 13 режимов внедряли для беспилотных авиасистем, автотранспорта, в сфере здравоохранения. И продолжим, конечно, тоже это развивать», — сообщил Чернышенко.

На слайде, показанном в ходе выступления, перечислены потенциальные меры, которые правительство намерено предпринять. Среди них указаны, в том числе, увеличение числа подписантов кодекса этики в сфере ИИ и упрощение механизма создания и изменения экспериментально правовых режимов.